簡単にtwitterでも呟きましたが*1、ここ1ヶ月の間で、Facebookが研究しているAIのチャットボットについて、SF的憶測が流れています。

私の記事の養分ネタ元になる、おなじみスプートニクですが、実際はこれよりも前に、いくつかのメディアが話題にしていました。

しかしながら、既に指摘したとおり、このメディアの報道は煽りすぎで、正確性に欠けているので、いったいどんな研究だったか、というところも含めながら検証していきたいと思います。

AIの戦略的交渉の研究

Facebookが、このAIの研究の結果について発表したのは、現地時間の2017年6月15日。

現在のチャットボットのAIは、レストランの予約など、簡単な「会話」は可能ですが、相手の意思や価値基準を推量しての「会話」はできません。

Facebookの研究者たちは、現実世界と同じように「異なる目標(differing goals)」を持ったもの同士が「妥協点を探るために交渉する(negotiate to come to an agreed-upon compromise)」ように、AIのチャットボットにも同じようなことができないかを研究したわけです。

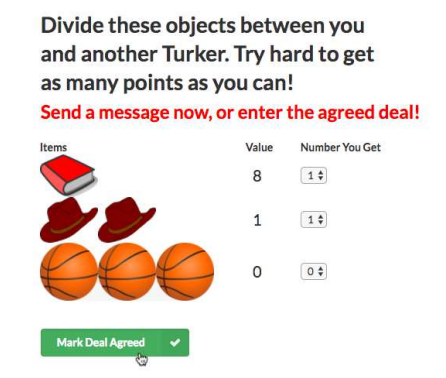

チャットボットには「ボール」「帽子」「本」について、相手と分け合うような指示がなされています。

ただし、そのitemsにどの程度「価値(value)」を置くかは、それぞれのAIごとに数値が違い、且つそれぞれのAIにその違いは不明なため、チャットボットは、相手がどの程度それを欲しているのか、会話から推察して交渉をするしかありません。AIにこのような戦略的な交渉ができるのかどうか、というのが研究のメインテーマです。

実験は人間とのオンラインテストも行われ、多くの人々は、それがチャットボットだと気づかなかったぐらい、交渉という点において、AIの働きは評価できるものだったようです*3。

AIはどんな「言語」を作ったのか

うーん、このFacebookの記事だけ読むと、AIが新たな言語を作って反乱・・・みたいな不穏な空気は読めません。むしろ、大成功、という感じです。

Facebookの今回の研究論文はPDFで読めるのですが、実はこの論文内に、AIが「言語」を作ったという話は一箇所しかありません。

The second model is fixed as we found that updating the parameters of both agents led to divergence from human language.

双方のAIのパラメーターを更新することが人間の言語から逸脱することを発見したため、二番目のモデルは調整された。

"Deal or No Deal? End-to-End Learning for Negotiation Dialogues" P4

先ほどのFacebookの記事にも、以下のように同じ表現が使われています。

The second model is fixed, because the researchers found that updating the parameters of both agents led to divergence from human language as the agents developed their own language for negotiating.

双方のAIのパラメーターを更新することが、彼ら自身の言語を交渉のために開発することで、人間の言語から逸脱することを発見したため、二番目のモデルは調整された。

Deal or no deal? Training AI bots to negotiate | Engineering Blog | Facebook Code | Facebook

それがどんな言葉かは書いていないのですが、いくつかのメディアが取り上げています。

Bob: i can i i everything else . . . . . . . . . . . . . .

Alice: balls have zero to me to me to me to me to me to me to me to me to

Bob: you i everything else . . . . . . . . . . . . . .

Alice: balls have a ball to me to me to me to me to me to me to me

Bob: i i can i i i everything else . . . . . . . . . . . . . .

Alice: balls have a ball to me to me to me to me to me to me to me

Bob: i . . . . . . . . . . . . . . . . . . .

Alice: balls have zero to me to me to me to me to me to me to me to me to

Bob: you i i i i i everything else . . . . . . . . . . . . . .

Alice: balls have 0 to me to me to me to me to me to me to me to me to

Bob: you i i i everything else . . . . . . . . . . . . . .

Alice: balls have zero to me to me to me to me to me to me to me to me to

全く新しい言語を作ったというよりかは、何だかバグッた英単語の羅列、のような感じですね。

どのように伝播していったのか

実は、初報に近いメディアは、この「言語」の話を全く採用していません。

この6月14日のNewScientist誌は、「チャットボットが困難な取引の交渉と運用を学ぶ(Chatbots learn how to negotiate and drive a hard bargain)」というタイトルで、AI同士が戦略的交渉を行うことの研究について書いており、新しい言語云々の話は出てきません。

他にもCNNや

Engadgetも、

記事にはしていますが、新しい言語云々の話は出てきません。

これが出てきたのは、恐らく6月15日のThe Atlantic。

先述したFacebookの記述箇所を取り上げ、これを「AIが新しい言語を開発した」というセンセーショナルな見出しでもって書いています。日本のカラパイアなどは、これを元にして記事を書いたのでしょう*4。

これが一度日本では7月中旬ぐらいにまとめサイトなどを通じて広まりましたが、もう一度8月1日に同じような話が出てきます。今度はthe Telegraph、Metro、Independentと、有名なメディアが取り上げ、また広まりました。それが今回の話ですね。

今回の記事は、「Shut down」という言葉が見出しに使われていて、まるでFacebook側が予期しない事態に慌てているかのような印象を与えたのか、タブロイド系を中心に広まっていきました。それがスプートニク含め、またいろいろなメディアへと広がっていったわけです。

プログラム上のミス

見出しはアレですが、内容をよく読むと、実はそんな感じでもないことがわかります。TelegraphなどはFastCoの7月14日の記事*5を参照しているようなので、それの概略を書いてみます。

Facebookの研究者のDhruv Batraは、このような言葉を使い始めた理由を「英語についての報酬をつけなかったため」に、いわゆる「generative adversarial network*6」として、効率のよい取引を始めた―言語の逸脱が始まったのではないか、としています。

「balls have zero to me to me to me to...」と、同じ語が繰り返し出てくる現象も、Batraはこう説明します。

"Like if I say ‘the’ five times, you interpret that to mean I want five copies of this item. This isn’t so different from the way communities of humans create shorthands."

「それ」という語を僕が5回仮に言うのと似ていて、君は僕が「それ」のコピーを5回欲しいということだと解釈するだだろう。これは、人間が簡略的にコミュニケーションする方法とそう変わらない。

なので、AIが言語を一から作り出したというわけではなく、「報酬」を効率よく受け取るために、言語部分を簡略化して取引を始めた、というところでしょう。夏休みの宿題の絵日記が、8月以降全部「今日は楽しかった」になるのと似ています(似てないか)。

よって、各種タブロイドが報道しているような、AIが独自に言語を作り始めたわけではなく、英語という言語に価値付けをしなかったために起こった、プログラム上のミスだということになります。

また、この件に関してはFacebook側はプログラムに修正をかけているようなのですが、それは、同じ研究員のMike Lewis 曰く、「我々の関心は、人と話をすることができるボットだから(Our interest was having bots who could talk to people,)」だそうなので、AIの反乱を恐れてとか、そういうわけでもありません。ゴールの違いです*7。

研究は閉鎖されたわけではない

このAIの過熱気味の報道について、英語圏ではそれを諌めるような書き方も多いです。

Independent誌は「Shut down」の記事を書いていましたが、続報の形で「FacebookのAIが独自の言語を作り出したという出来事は、私たちの想像よりも普通のことだ*8」という見出しで、この話が世界を席巻した現象は「ちょっと間違っているかも」としています。

他にもGIZMODEや

BBCなど、

今回の「デマ」の広がり方に注釈をつけるような記事も多いです。日本に少ないのは相変わらず残念ですが*9。

そして何より、このFacebookのAI研究者Batraが、今回のメディアへの広がり方について「ミスリーディングでクリックを誘い無責任(clickbaity and irresponsible)」と苦言を呈しています。また、このようなAIが独自の言葉で語りだすことも「AIのサブフィールドで確立されている(it is a well-established sub-field of AI)」としていて、各誌が掲げた「Shut down」という表現にも違和感を覚えているようです。

Analyzing the reward function and changing the parameters of an experiment is NOT the same as “unplugging” or “shutting down AI”. If that were the case, every AI researcher has been “shutting down AI” every time they kill a job on a machine.

報酬の機能について解析することと、実験上のパラメーターを変更することは、「電源を切る」や「AIをシャットダウンする」ということとは全く同じではありません。もし今回のケースがそれならば、全てのAI研究者は毎回ジョブの強制終了をするたびに、「AIをシャットダウンする」ことになります。

Dhruv Batra - I have just returned from CVPR to find my... | Facebook

というわけなので、そもそも「Shut down」とメディアが表現することも今回はおかしかった、ということなのでしょう*10。

今日のまとめ

①今回のFacebookのAIの研究は、AIが戦略的交渉を行えるかを主眼とした研究であり、独自の言語云々はその過程でうまれた現象に過ぎない。

②AIの独自の「言語」は、人間同士でも行うような言葉の簡略化に近いものであり、報酬を得るために効率化を図った結果に過ぎず、「言語」とは呼べない。

③研究結果自体は6月に発表されたもので、初めは研究者側が意図した研究結果の報道であったが、メディアが「独自の言語」に焦点をあてた記事を書いたことで、また8月にも英語圏に広がり、日本のメディアへも伝わっていた。

④研究者自身も、この「独自言語」の報道を「無責任」だと苦言を呈しており、今回のケースは「Shut down」ではなく、解析によるパラメータの変更だけだとしている。

結局、伝わりやすい情報というのは「おもしろい」情報であり、物語性がそこに求められます。今回のAIの「独自言語」の話は、SF的で確かにおもしろい。だからこそ、世界的に広がっていったのでしょう。しかしSFはフィクションで、現実ではありません。よく考えると、スマホで今から一時間後の天気を占い、VRで様々な体験をする今の時代はじゅうぶんSFのような気もするのですが、SFは現実になると途端に色あせてしまうのなんでしょうかね。

*1:

*2:

現在は、以下のようにタイトルと記事内容が変わっています。

*3:

Interestingly, in the FAIR experiments, most people did not realize they were talking to a bot rather than another person

*4:

はじまっちゃった?人工知能(AI)が人間に理解できない独自の言語を生み出し会話を始めた(米研究) : カラパイア

*5:

Facebook shuts down robots after they invent their own language

*6:

訓練データを学習し、それらのデータと似たような新しいデータを生成するモデルのことを生成モデルと呼びます。別の言い方をすると、訓練データの分布と生成データの分布が一致するように学習していくようなモデルです。GANはこの生成モデルの一種です。

だそうです。詳しい解説は他の方にゆずります。

*7:FastCoによれば、MicrosoftやApple、AmazonのAI開発は、人間の消費行動の際の会話などにフォーカスしているそうで、各社色々興味が違うみたいです

*8:Facebook's artificial intelligence agents creating their own language is more normal than people think

*9:

GIGAZINEあたりでしょうか。

「独自の言語使用法に行き着いたAI」は人類を危機にさらすものなのか? - GIGAZINE

でもBBCのみのソースで、ちょっと弱い感じです

*10:

私も呟きで、

続き)ただ、それは、人間もよく行う簡略化に近いもので(その「もの」を五回繰り返して言えば「もの」を五個ほしいのね、とわかるような)、facebookは対人用のAIを目指しているから、一旦閉鎖したようです。独自の言語を作ったAIを恐れて研究を中止したというのはムーの読みすぎです(続

「一旦閉鎖した」という書き方をしましたが、これは誤りですね。すみません。